Beiträge

Wie Aufmerksamkeitssinks Sprachmodelle stabil halten

/

0 Kommentare

In diesem Artikel untersuchen wir das Konzept der Aufmerksamkeitssinks in Sprachmodellen und wie sie dazu beitragen, die Stabilität während langer Gespräche zu gewährleisten.

Text-to-LoRA: Instant Transformer Adaption

Forscher von Sakana AI haben mit Text-to-LoRA ein System entwickelt, das große Sprachmodelle sofort anpassen kann, basierend auf einer textuellen Beschreibung der Zielaufgabe.

JavelinGuard: Low-Cost Transformer-Architekturen für die Sicherheit von LLMs

JavelinGuard ist eine Suite von kostengünstigen, leistungsstarken Modellarchitekturen, die entwickelt wurden, um böswillige Absichten in Interaktionen mit großen Sprachmodellen zu erkennen.

YOU COULD’VE INVENTED TRANSFORMERS

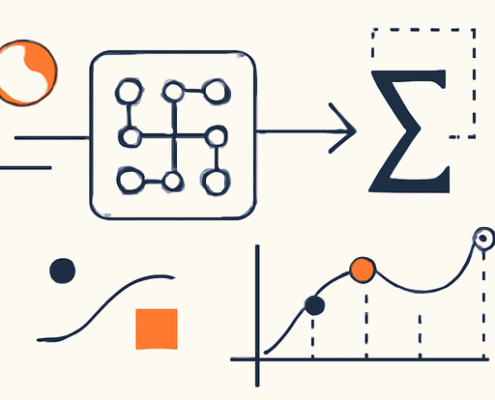

Die grundlegende Architektur von LLMs kann als eine Reihe von einfachen Schritten erklärt werden, die vom 0-Zählproblem der n-grams über Embeddings, neuronale Sprachmodelle bis hin zur Selbstaufmerksamkeit reichen.

Die Entwicklung moderner Techniken seit ‘Attention Is All You Need’

In diesem Artikel werfen wir einen Blick auf einige der wichtigsten Innovationen, die seit der Veröffentlichung des Papiers 'Attention Is All You Need' entstanden sind.

Wie Ein-Schicht-Transformer Regelsprachen erkennen: Eine theoretische Analyse der Trainingsdynamik und impliziten Bias

In diesem Artikel werfen wir einen detaillierten Blick auf die Funktionsweise von Ein-Schicht-Transformern und deren Fähigkeit, Regelsprachen zu erkennen, basierend auf einer theoretischen und empirischen Analyse.