Beiträge

Warum KI-Modelle so viele Em-Dashes verwenden

/

0 Kommentare

In der Welt der KI-generierten Texte ist die Verwendung von Em-Dashes zu einem markanten Merkmal geworden. Viele Menschen, die diese Satzzeichen lieben, haben sich sogar davon abgewandt, aus Angst, mit KI verwechselt zu werden.

Context Rot: Wie sich die Erhöhung der Eingabetokens auf die Leistung von LLMs auswirkt

Die Leistung von Large Language Models (LLMs) verschlechtert sich signifikant, wenn die Eingabelänge zunimmt, selbst bei einfachen Aufgaben wie der Textabfrage und -replikation. Dieser Artikel untersucht die Auswirkungen von langen Eingaben auf die Modellleistung und die Herausforderungen, die sich daraus ergeben.

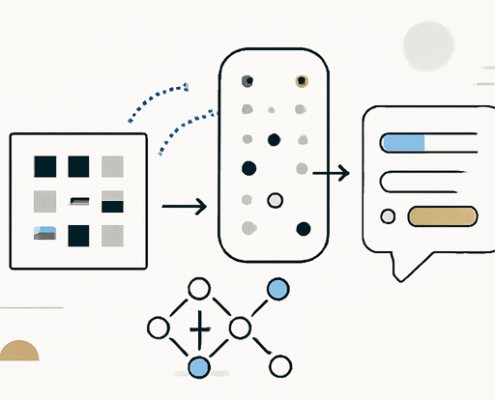

FINETUNING SPARSE ENCODERS WITH SENTENCE TRANSFORMERS

In diesem Artikel werden die neuesten Entwicklungen in der Python-Bibliothek Sentence Transformers behandelt, die Unterstützung für das Training von spärlichen Einbettungsmodellen bietet.

Chonkie: Die ultimative Chunking-Bibliothek für schnelle Textverarbeitung

Chonkie ist eine ultraleichte und blitzschnelle Chunking-Bibliothek, die sich durch eine Vielzahl von Funktionen, Mehrsprachigkeit und Cloud-Bereitschaft auszeichnet.