Beiträge

Forschungsprobleme im maschinellen Lernen: Neue Ansätze und Herausforderungen

/

0 Kommentare

Der Artikel beleuchtet verschiedene Forschungsprobleme im maschinellen Lernen, einschließlich designbasierter Ansätze, Wettbewerbstests und offener Sprachmodelle. Ziel ist es, aktuelle Trends und Herausforderungen zu diskutieren.

Der aktuelle Stand der KI: Nutzung von großen Sprachmodellen in der realen Welt

In diesem Artikel untersuchen wir den aktuellen Stand der KI, insbesondere die Verwendung von großen Sprachmodellen (LLMs) in der realen Welt, und analysieren die Trends, die diese Entwicklung vorantreiben.

Das Ende der Train-Test-Trennung

In diesem Artikel untersuchen wir die Herausforderungen der Train-Test-Trennung in der maschinellen Lernens, insbesondere im Kontext komplexer Klassifikationsaufgaben und der Notwendigkeit von Expertenlabels.

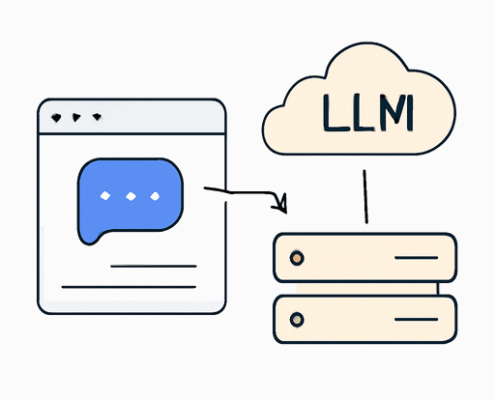

Wie Prompt Caching funktioniert

In diesem Artikel erfahren Sie, wie Prompt Caching funktioniert und welche Techniken zur Optimierung der Effizienz von Large Language Models (LLMs) eingesetzt werden können.

DeepSeek-Math-V2: Fortschritte im mathematischen Denken durch KI

DeepSeek hat mit seinem neuen Modell DeepSeek-Math-V2 bedeutende Fortschritte im mathematischen Denken erzielt, das Gold-Level-Leistungen bei internationalen Wettbewerben erreicht hat.

Open Deep Research: Der innovative Open-Source-Forschungsassistent

Open Deep Research ist ein innovativer, Open-Source-Forschungsassistent, der auf LangGraph basiert und die Automatisierung von tiefgreifenden Forschungsthemen ermöglicht.

Continuous Batching: Effiziente Verarbeitung von Anfragen in LLMs

In diesem Artikel wird das Konzept des Continuous Batching untersucht, das die Effizienz von großen Sprachmodellen maximiert, indem es mehrere Konversationen parallel verarbeitet.

Die wirtschaftlichen Aspekte von LLMs: Ein Blick auf die Unit Economics

In diesem Artikel beleuchten wir die wirtschaftlichen Aspekte von LLMs und deren Training, die Herausforderungen der Kosten und die Ansätze von Unternehmen wie OpenAI und Anthropic.

LLMs können ihre eigene Kompression erfinden

Der Artikel beleuchtet die neuesten Innovationen in der Modellkompression durch LLMs und zeigt, wie diese Technologien die Effizienz der Textverarbeitung erheblich steigern können.