Beiträge

INT4 Quantization-Aware Training: Effiziente Rollouts für große Modelle

/

0 Kommentare

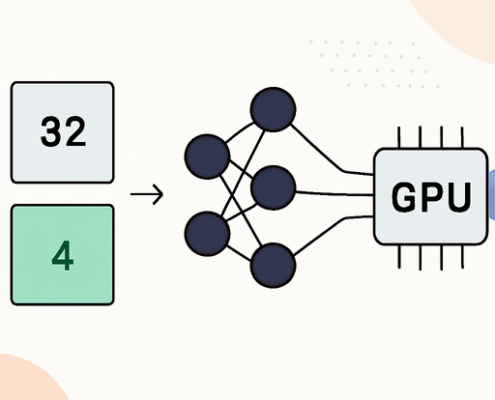

Der Artikel behandelt die Implementierung des INT4 Quantization-Aware Trainings, das es ermöglicht, große KI-Modelle effizient auf einer einzigen H200 GPU zu betreiben.

Quantisierung ist kein Kompromiss – es ist das nächste Paradigma

Die Veröffentlichung von K2-Thinking hat das Interesse an der INT4-Quantisierung geweckt, die das Training von Reinforcement Learning beschleunigt und als neues Paradigma für große Modelle gilt.