ContinualFlow in Generative Models

/

0 Kommentare

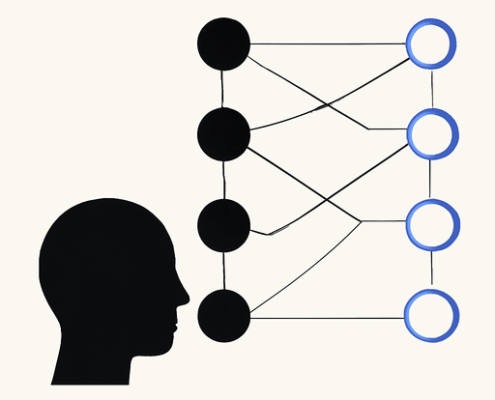

ContinualFlow ist ein neuartiger Ansatz für gezieltes Unlearning in generativen Modellen, der unerwünschte Datenbereiche effizient subtrahiert, ohne eine vollständige Neutrainierung zu erfordern.

Die Risiken des moralischen Status von KI

Die Möglichkeit, dass KIs als 'moralische Patienten' behandelt werden, wirft ethische Bedenken auf, da fortschrittliche KI zunehmend integraler Bestandteil der Gesellschaft wird.

OPENAI MRCR: Long Context Benchmark für LLMs

Das OpenAI MRCR Dataset ist ein langes Kontext-Dataset, das die Fähigkeit von LLMs testet, mehrere identische Anfragen in einem komplexen Dialog zu identifizieren und zu verarbeiten.

Reinforcement Learning: Ein Überblick mit minimalem mathematischen Jargon

Reinforcement Learning (RL) lehrt KI-Modelle durch Versuch und Irrtum, wodurch sie aus Fehlern lernen und sich auf komplexe Aufgaben konzentrieren können. In diesem Artikel wird die Entwicklung von RL und seine Bedeutung für moderne KI-Systeme erläutert.

Evaluierung von Long-Context Q&A-Systemen

In diesem Artikel werden Metriken, das Design von Datensätzen und Methoden zur Bewertung von Long-Context-Q&A-Systemen untersucht. Dabei werden Herausforderungen wie Informationsüberflutung, verstreute Beweise, Mehrfachschlussfolgerungen und Halluzinationen umrissen.

Reinforcement Learning Teachers of Test Time Scaling

Die Einführung von Reinforcement Learned Teachers revolutioniert die Ausbildung von KI-Modellen, indem sie sich auf das Lehren und die Bereitstellung klarer Erklärungen konzentrieren.

Reinforcement Learning Scaling: Netzwerk-Sparsity als Schlüssel zur Effizienz

In diesem Artikel beleuchten wir, wie Netzwerk-Sparsity das Potenzial von Deep Reinforcement Learning Modellen freisetzen kann und welche Vorteile dies für die Skalierung mit sich bringt.

CUTTING LORA REDUNDANCY

SeLoRA re-parametrisiert LoRA-Adapter in einem spärlichen spektralen Unterraum, entfernt redundante Parameter und steigert die Genauigkeit bei verschiedenen Aufgaben.

YOU SOUND LIKE CHATGPT

AI verändert nicht nur, wie wir schreiben – es beeinflusst auch, wie wir sprechen und miteinander interagieren. Diese Entwicklung wird in den kommenden Jahren noch zunehmen.