Die Zukunft der Videoerstellung: Saber und die Null-Schuss-Generierung

In der heutigen digitalen Welt, in der visuelle Inhalte eine zentrale Rolle spielen, ist die Fähigkeit, qualitativ hochwertige Videos schnell und effizient zu erstellen, von größter Bedeutung. Saber, ein innovatives Framework zur Videoerstellung, setzt neue Maßstäbe in der Branche. Es ermöglicht die Generierung von Videos aus Referenzbildern und Textaufforderungen, ohne auf umfangreiche Datensätze angewiesen zu sein. Dieser Artikel beleuchtet die Funktionsweise von Saber, seine Vorteile und die Herausforderungen, die noch bewältigt werden müssen.

Einführung in Saber

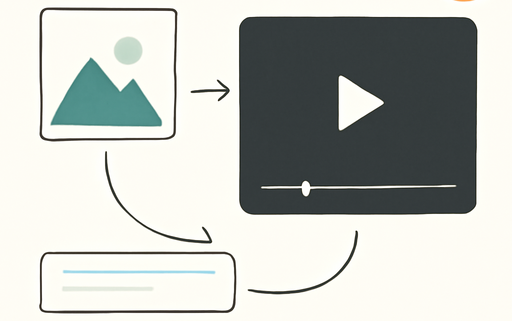

Die Referenz-zu-Video (R2V) Generierung hat sich als eine der vielversprechendsten Technologien im Bereich der künstlichen Intelligenz etabliert. Sie zielt darauf ab, Videos zu synthetisieren, die mit Textaufforderungen übereinstimmen und gleichzeitig die Identität des Subjekts aus Referenzbildern bewahren. Bisherige Methoden waren jedoch stark von expliziten R2V-Datensätzen abhängig, die aus Tripeln von Referenzbildern, Videos und Textaufforderungen bestehen. Diese Herangehensweise ist kostspielig, schwer skalierbar und schränkt die Generalisierbarkeit auf unbekannte Subjektkategorien ein. Saber überwindet diese Einschränkungen durch ein skalierbares Null-Schuss-Framework, das ausschließlich auf Video-Text-Paaren trainiert wird.

Methodologie

Das Herzstück von Saber ist eine maskierte Trainingsstrategie, bei der zufällig ausgewählte und teilweise maskierte Videoframes als Referenzen dienen. Dies zwingt das Modell dazu, identitätskonsistente Repräsentationen zu erlernen, ohne auf explizite R2V-Daten angewiesen zu sein. Ein maßgeschneidertes Aufmerksamkeitsmechanismus, das durch Aufmerksamkeitsmasken geleitet wird, lenkt die Aufmerksamkeit des Modells auf referenzbewusste Merkmale und unterdrückt Hintergrundgeräusche. Darüber hinaus werden räumliche Maskierungsaugmentierungen eingesetzt, um die typischen Kopier- und Einfügeartefakte zu minimieren, die bei der Referenz-zu-Video-Generierung häufig auftreten.

Ergebnisse

Auf dem OpenS2V-Eval-Benchmark übertrifft Saber konstant Modelle, die explizit auf R2V-Daten trainiert wurden. Dies zeigt die starke Null-Schuss-Generalisierung und Skalierbarkeit von Saber. Die Ergebnisse belegen, dass das Modell in der Lage ist, Videos zu erstellen, die sowohl qualitativ hochwertig sind als auch die Identität der Subjekte bewahren. Im Vergleich zu anderen Methoden wie Kling1.6, Phantom und VACE zeigt Saber eine überlegene Subjektbewahrung und Videoqualität.

Emergente Fähigkeiten

Ein bemerkenswerter Vorteil von Saber ist die Fähigkeit, mit einer variierenden Anzahl von Referenzbildern umzugehen. Dies ermöglicht eine reichhaltigere Anpassung an mehrere Subjekte und verschiedene Ansichten desselben Subjekts. Darüber hinaus zeigt Saber eine robuste Ausrichtung zwischen Referenzbildern und Textaufforderungen, was bedeutet, dass das Modell in der Lage ist, visuelle Änderungen genau widerzuspiegeln, wenn die Beschreibungen in den Aufforderungen geändert werden.

Einschränkungen

Trotz seiner beeindruckenden Fähigkeiten hat Saber auch einige Einschränkungen. Eine der größten Herausforderungen besteht darin, dass die R2V-Generierung zusammenbrechen kann, wenn die Anzahl der Referenzbilder erheblich zunimmt. Dies kann zu fragmentierten Kompositionen führen, bei denen die Referenzen ohne kohärentes Verständnis kombiniert werden. Darüber hinaus konzentriert sich Saber hauptsächlich auf die Identitätserhaltung und visuelle Kohärenz, während die feingranulare Bewegungssteuerung und zeitliche Konsistenz unter komplexen Aufforderungen weiterhin herausfordernd bleiben.

Fazit

Insgesamt stellt Saber einen bedeutenden Fortschritt in der Referenz-zu-Video-Generierung dar. Es zeigt, dass effektive R2V-Modelle ohne dedizierte Datensätze trainiert werden können, was den Weg für zukünftige Forschungen in der skalierbaren und generalisierbaren Videoerstellung ebnet. Die Kombination aus maskierter Trainingsstrategie, maßgeschneidertem Aufmerksamkeitsmechanismus und Maskierungsaugmentierung ermöglicht es Saber, qualitativ hochwertige Videos zu generieren, die sowohl identitätskonsistent als auch visuell ansprechend sind.

Quellenliste:

- Quelle: Scaling Zero-Shot Reference-to-Video Generation

- Zijian Zhou’s Homepage

- Shikun Liu’s Homepage

- Haozhe Liu’s Homepage

- Kam Woh Ng’s Homepage

Hinterlasse einen Kommentar

An der Diskussion beteiligen?Hinterlasse uns deinen Kommentar!