Continuous Batching: Effiziente Verarbeitung von Anfragen in LLMs

In der heutigen Welt der künstlichen Intelligenz und insbesondere bei der Nutzung von großen Sprachmodellen (LLMs) wie ChatGPT oder Claude ist die Effizienz der Verarbeitung von Anfragen von entscheidender Bedeutung. In diesem Artikel werden wir das Konzept des Continuous Batching untersuchen, das darauf abzielt, die Durchsatzrate zu maximieren, indem mehrere Konversationen parallel verarbeitet werden.

Das Verständnis der Funktionsweise von LLMs ist der erste Schritt, um die Vorteile des Continuous Batchings zu erkennen. LLMs arbeiten, indem sie Texte in Token zerlegen und diese Token dann sequenziell verarbeiten, um Vorhersagen für das nächste Token zu treffen. Dieser Prozess ist rechenintensiv, da jedes Token durch Milliarden von Parametern geleitet wird, was zu einer hohen Latenz führt, insbesondere wenn viele Benutzer gleichzeitig bedient werden müssen.

Die Grundlagen der LLMs und der Aufmerksamkeitsmechanismus

Der Aufmerksamkeitsmechanismus ist das Herzstück der Funktionsweise von LLMs. Bei der Verarbeitung eines Textes wird dieser in Token zerlegt, die dann in einem neuronalen Netzwerk verarbeitet werden. Für jede Token-Sequenz berechnet das Netzwerk eine Vorhersage für das nächste Token. Dies geschieht durch die Berechnung von Aufmerksamkeitswerten, die bestimmen, wie die Tokens miteinander interagieren.

Ein zentraler Aspekt ist die Verwendung von KV-Caching, das es ermöglicht, die Repräsentationen bereits verarbeiteter Tokens zu speichern. Dies reduziert die Rechenkosten erheblich, da die Schlüssel- und Wertprojekte für Tokens, die bereits verarbeitet wurden, nicht erneut berechnet werden müssen. Dadurch kann die Berechnung der nächsten Token-Vorhersage von O(n²) auf O(n) reduziert werden.

Chunked Prefill und Ragged Batching

Ein weiteres wichtiges Konzept ist das Chunked Prefill, das es ermöglicht, lange Eingabeaufforderungen in kleinere Abschnitte zu unterteilen, die in den verfügbaren GPU-Speicher passen. Dies ist besonders wichtig, wenn die Eingabeaufforderungen sehr lang sind und die GPU-Speichergrenzen überschreiten.

Das Ragged Batching ist eine Technik, die es ermöglicht, mehrere Eingabeaufforderungen mit unterschiedlichen Längen zu kombinieren, ohne dass Padding erforderlich ist. Dies verbessert die Effizienz, da die GPU-Ressourcen optimal genutzt werden können, ohne dass zusätzliche Rechenleistung für das Padding verschwendet wird.

Continuous Batching: Maximierung der Effizienz

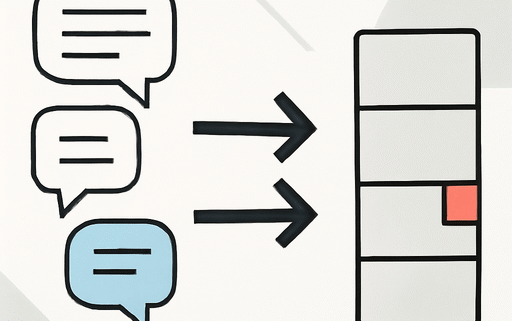

Das Continuous Batching kombiniert die oben genannten Techniken, um die Effizienz bei der Verarbeitung mehrerer Anfragen zu maximieren. Anstatt die Eingabeaufforderungen in einer festen Batch-Größe zu verarbeiten, werden sie dynamisch verwaltet. Wenn eine Anfrage abgeschlossen ist, wird sie durch eine neue Anfrage ersetzt, die auf die Warteliste gesetzt wurde. Dies wird als dynamische Planung bezeichnet und trägt dazu bei, die Durchsatzrate zu erhöhen.

Durch die Kombination von Chunked Prefill und Ragged Batching mit dynamischer Planung können LLMs wie ChatGPT Tausende von gleichzeitigen Benutzern effizient bedienen. Diese Techniken ermöglichen es, die GPU-Ressourcen optimal zu nutzen und die Latenzzeiten zu minimieren.

Fazit

Continuous Batching ist eine revolutionäre Technik, die die Art und Weise, wie LLMs Anfragen verarbeiten, grundlegend verändert. Durch die Kombination von KV-Caching, Chunked Prefill und Ragged Batching mit dynamischer Planung können LLMs effizienter arbeiten und eine höhere Anzahl von Anfragen gleichzeitig bedienen. Dies ist entscheidend für die Zukunft der KI-gestützten Anwendungen und Dienste.

Hinterlasse einen Kommentar

An der Diskussion beteiligen?Hinterlasse uns deinen Kommentar!